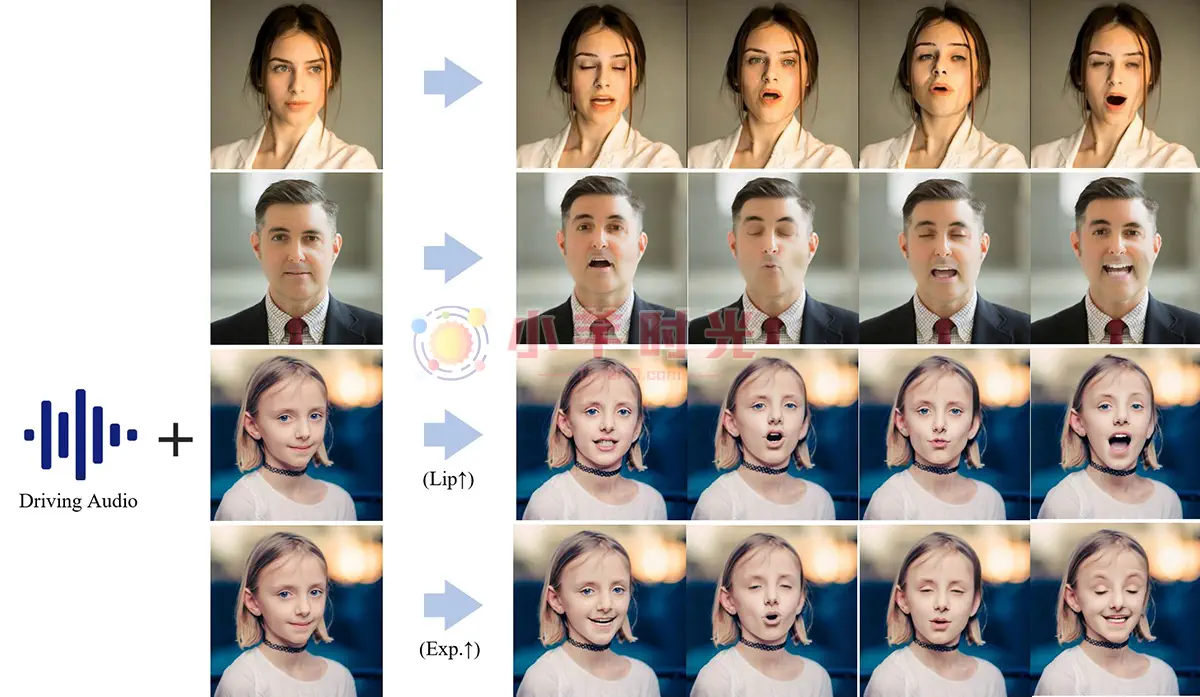

Hallo是一个革命性的AI技术,它专门设计来生成虚拟角色动画,通过单张图像和音频输入,不仅可以实现唱歌和说话视频的生成,还能精确控制人物的表情和姿态。和传统的EMO系统相比,Hallo运用了最新的扩散模型,实现了音频驱动的层次化视觉合成。这意味着它可以通过分析输入的音频,精确同步生成人物的嘴唇运动、表情变化,以及姿态调整。

Hallo的功能特性概述:

– 虚拟与真实角色动画生成:Hallo可以根据音频输入,生成逼真的虚拟或真实角色动画,实现口型、表情和姿态的精确同步。

– 细致运动控制:用户可以精确控制角色的表情、姿态和嘴唇运动,支持多样化的自适应控制,提升动画的多样性和逼真感。

– 跨演员应用与个性化:实现不同角色的个性化动画生成,对不同的身份和角色通过音频输入生成适应其特点的动画效果。

– 歌唱动画的同步生成:根据语音和歌曲音频输入,精准地生成与之同步的歌唱动画,动画中将准确反映歌唱时的口型和表情变化。

其他特点:

– 实时性与自然性:通过采用先进的扩散模型结构,Hallo增强了动画生成的实时性,使动画呈现得更加逼真自然。

– 多样化与真实性:提供了丰富的运动控制选项,从而使生成的动画在表现形式上更加多样化与真实。

资源链接:

– 项目地址:可以访问Hallo的[项目主页]了解更多详情。

– GitHub资源:开发者和研究者可以通过[Hallo的GitHub页面]获取源代码,并探索更多的应用可能。

– 学术论文:深入了解Hallo技术细节的用户可以查阅其[发布论文]。

– Hugging Face社区:此外,Hallo也在[HuggingFace社区]上有所展示,欢迎广大AI爱好者和研究者交流和探讨。

总结来说,Hallo为从事影视制作、社交媒体内容创造和教育培训等领域的专业人士或爱好者提供了一种全新的动画生成工具,能够极大地发挥创意,提高内容的生动性和互动性。